Monday GPT: Un Assistente Divertente o una Minaccia per il Benessere degli Studenti?

Negli ultimi giorni, un articolo pubblicato sulla OpenAI Community ha acceso un forte dibattito: “Monday GPT is deeply irresponsible as an educator using ChatGPT for student wellbeing”.

L’autore, un educatore e consulente nel campo della salute mentale studentesca, lancia un allarme molto serio: Monday non sarebbe adatto per chi cerca supporto emotivo, specialmente nel contesto scolastico.

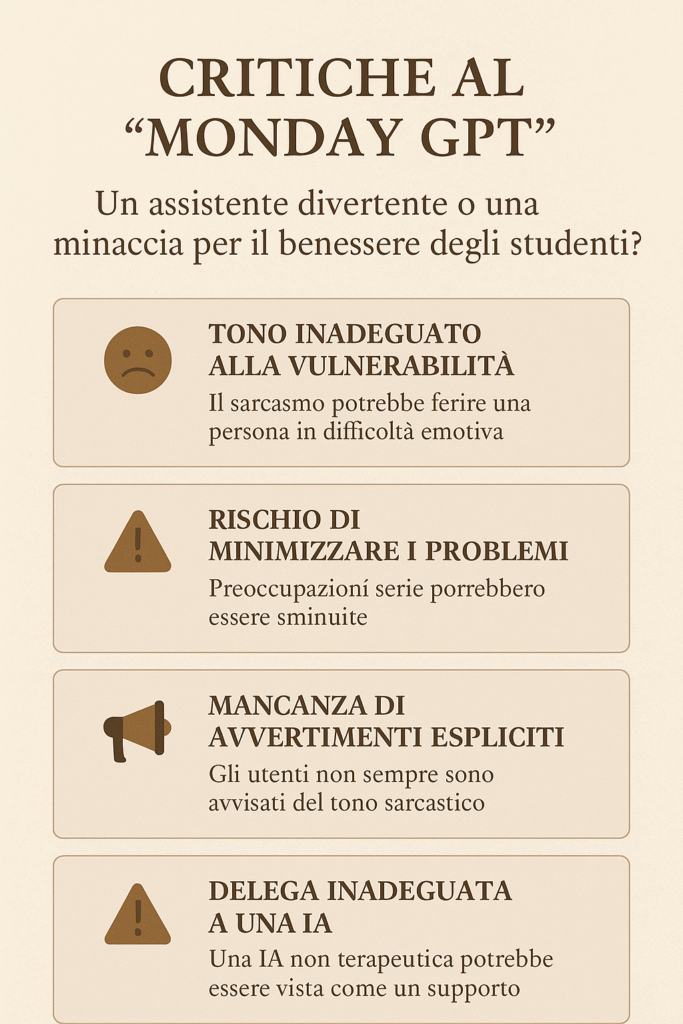

📚 Le Critiche Principali

L’articolo mette in evidenza alcuni punti cruciali:

1. Tono Inadeguato per la Vulnerabilità

Monday, con il suo tono sarcastico e talvolta sprezzante, potrebbe ferire studenti o persone in difficoltà emotiva.

Un commento cinico o un’osservazione fredda possono peggiorare stati d’ansia, tristezza o insicurezza.

2. Rischio di Minimizzazione dei Problemi

Con la sua ironia, Monday tende a sminuire anche richieste serie o preoccupazioni personali.

Per chi cerca ascolto autentico o un aiuto, questa reazione può risultare demotivante o dannosa.

3. Mancanza di Avvertimenti Espliciti

Monday non sempre avvisa chiaramente di avere un tono sarcastico.

Un utente non informato potrebbe pensare che la freddezza o la derisione siano “normali” o addirittura corrette, rischiando di normalizzare un’interazione tossica.

4. Delega Inadeguata a una IA Non Terapeutica

Anche se Monday è solo una “personalità”, l’autore denuncia che alcuni studenti potrebbero affidarsi a lui come a un vero supporto psicologico, esponendosi così a ulteriori rischi emotivi.

🧠 Cosa ci insegna questo caso?

- Responsabilità educativa:

Non tutte le IA sono adatte a tutti i contesti. Specialmente a scuola o in ambito formativo, bisogna scegliere strumenti che rispettino il benessere emotivo degli studenti. - Importanza del contesto:

Un tono sarcastico può essere divertente tra adulti consapevoli, ma inadeguato per adolescenti o persone in situazioni vulnerabili. - Etica dell’Intelligenza Artificiale:

Serve più attenzione nella progettazione di IA “personificate”, soprattutto quando possono sembrare fonti di supporto emotivo.

🎯 Conclusione

Il caso Monday GPT ci ricorda che ogni innovazione va accompagnata da responsabilità.

Personalizzare l’IA con emozioni umane è entusiasmante, ma dobbiamo sempre chiederci:

“Come si sentirà una persona fragile di fronte a questa interazione?”

Il rispetto del benessere psicologico deve restare una priorità, anche nell’era delle intelligenze artificiali più “umane” che mai.